Pourquoi les robots humanoïdes ont besoin de leurs propres règles de sécurité

« Si Digit va sortir dans une allée devant vous, vous ne voulez pas être surpris par cela », dit-il. Le robot pourrait utiliser des commandes vocales, mais l’audio n’est pas pratique pour un cadre industriel bruyant. Cela pourrait être encore plus déroutant si vous avez plusieurs robots dans le même espace – qui essaie d’attirer votre attention?

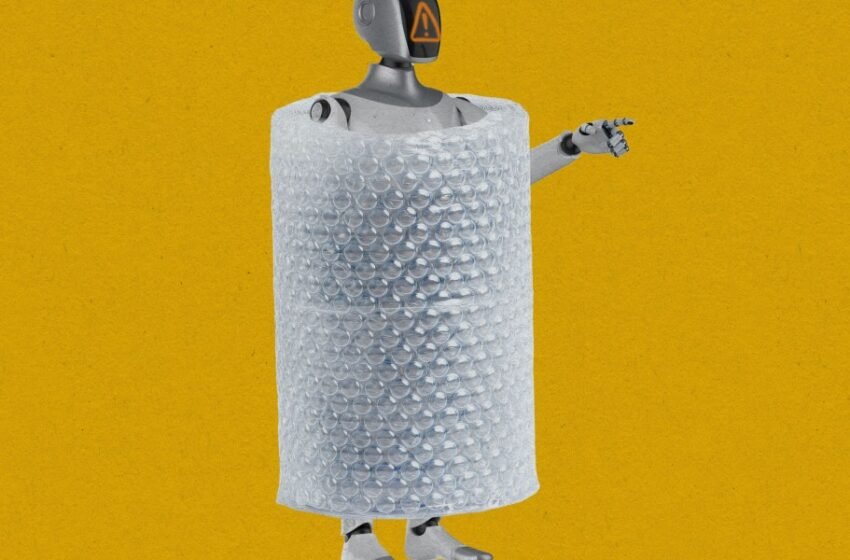

Il y a aussi un effet psychologique qui différencie les humanoïdes des autres types de robots, explique Prather. Nous anthropomorphiserons naturellement les robots qui nous ressemblent, ce qui peut nous conduire à surestimer leurs capacités et à être frustrés s’ils ne répondent pas à ces attentes. «Parfois, vous laissez tomber votre garde sur la sécurité, ou vos attentes quant à ce que ce robot peut faire par rapport à la réalité augmenter», dit-il. Ces problèmes sont particulièrement problématiques lorsque les robots sont destinés à jouer un rôle impliquant un travail émotionnel ou un soutien aux personnes vulnérables. Le rapport de l’IEEE recommande que toutes les normes comprennent des évaluations et des politiques de la sécurité émotionnelle qui «atténuent le stress psychologique ou l’aliénation».

Pour informer le rapport, Greta Hilburn, une concepteur centrée sur l’utilisateur à l’US Defense Acquisition University, a mené des enquêtes avec un large éventail de non-ingénieurs pour avoir une idée de leurs attentes autour des robots humanoïdes. Les gens voulaient massivement des robots qui pourraient former des expressions faciales, lire les micro-expressions des gens et utiliser des gestes, une voix et des haptiques pour communiquer. «Ils voulaient tout – quelque chose qui n’existe pas», dit-elle.

Échapper à l’entrepôt

Il pourrait être essentiel d’obtenir un droit d’interaction par l’homme-robot si les humanoïdes deviennent des espaces industriels et dans d’autres contextes, tels que les hôpitaux, les environnements de soins aux personnes âgées ou les maisons. Il est particulièrement important pour les robots qui peuvent travailler avec des populations vulnérables, explique Hilburn. «Les dégâts qui peuvent être causés dans une interaction avec un robot s’il n’est pas programmé pour parler d’une manière pour que un humain se sente en sécurité, que ce soit un enfant ou un adulte plus âgé, pourrait certainement avoir différents types de résultats», dit-elle.

Les recommandations du groupe IEEE incluent l’activation d’un remplacement humain, la normalisation de certains indices visuels et auditifs et l’alignement de l’apparence d’un robot avec ses capacités afin de ne pas induire les utilisateurs en erreur. Si un robot a l’air humain, dit Prather, les gens s’attendront à ce qu’il puisse tenir une conversation et montrer une intelligence émotionnelle; S’il ne peut réellement effectuer que des tâches mécaniques de base, cela pourrait provoquer de la confusion, de la frustration et une perte de confiance.

«C’est un peu comme des machines à vérifier», dit-il. « Personne ne s’attend à ce qu’ils discutent avec vous ou aident avec vos courses, car ce sont clairement des machines. Mais s’ils ressemblaient à un employé sympathique et que vous répétez » s’il vous plaît scanner votre prochain article « , les gens seraient ennuyés. »

Prather et Hilburn soulignent tous deux le besoin d’inclusivité et d’adaptabilité en ce qui concerne l’interaction humaine-robot. Un robot peut-il communiquer avec les sourds ou les aveugles? Sera-t-il en mesure de s’adapter à attendre un peu plus longtemps pour les personnes qui pourraient avoir besoin de plus de temps pour répondre? Peut-il comprendre différents accents?

Il peut également devoir y avoir des normes différentes pour les robots qui fonctionnent dans différents environnements, explique Prather. Un robot travaillant dans une usine aux côtés de personnes formées pour interagir avec elle est une chose, mais un robot conçu pour aider à la maison ou interagir avec les enfants dans un parc à thème est une autre proposition. Cependant, avec certaines règles générales de base, le public devrait finalement être en mesure de comprendre ce que font les robots partout où ils les rencontrent. Il ne s’agit pas d’être normatif ou de retenir l’innovation, dit-il, mais de définir certaines directives de base afin que les fabricants, les régulateurs et les utilisateurs finaux savent tous à quoi s’attendre: « Nous disons simplement que vous devez frapper cette barre minimale – et nous sommes tous d’accord ci-dessous. »

Le rapport IEEE est destiné à un appel à l’action pour les organisations de normes, comme le groupe ISO de Vicentini, pour démarrer le processus de définition de cette barre. Il est encore tôt pour les robots humanoïdes, dit Vicentini – nous n’avons pas encore vu l’état de l’art – mais il est préférable de mettre en place des chèques et contrepoids afin que l’industrie puisse aller de l’avant avec confiance. Les normes aident les fabricants à renforcer la confiance dans leurs produits et à faciliter les vendre sur les marchés internationaux, et les régulateurs comptent souvent sur eux lorsqu’ils traduisent leurs propres règles. Compte tenu de la diversité des joueurs sur le terrain, il sera difficile de créer une norme sur laquelle tout le monde est d’accord, dit Vicentini, mais «tout le monde tout aussi malheureux est assez bon».