Inside Experiment aux enjeux élevés d’Amsterdam pour créer une juste prestation de bien-être AI

Trouver une meilleure façon

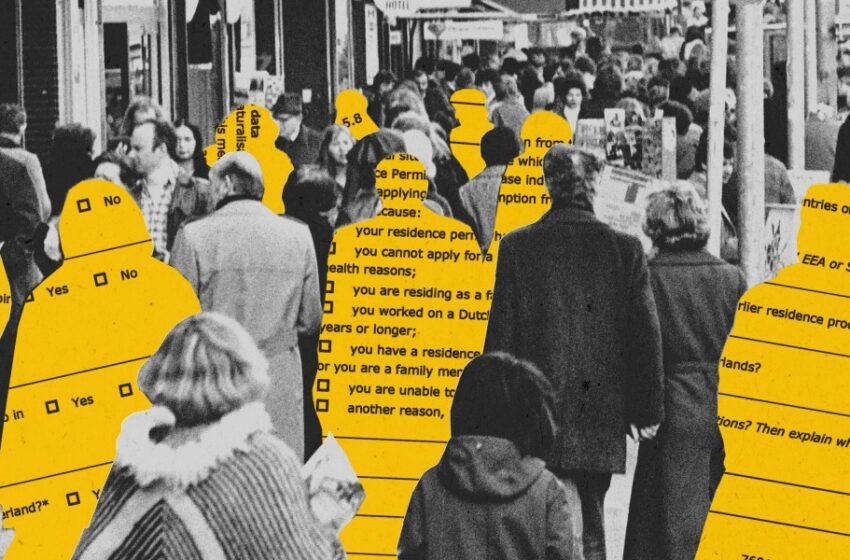

Chaque fois qu’un résident d’Amsterdam demande des avantages sociaux, un travailleur social passe en revue la demande d’irrégularités. Si une demande semble suspecte, elle peut être envoyée au service des enquêtes de la ville – ce qui pourrait entraîner un rejet, une demande de corriger les erreurs de paperasse ou une recommandation que le candidat reçoit moins d’argent. Les enquêtes peuvent également se produire plus tard, une fois les avantages dispersés; Le résultat peut obliger les bénéficiaires à rembourser les fonds et même en remettre certains endettés.

Les fonctionnaires ont une large autorité sur les candidats et les bénéficiaires de protection sociale existants. Ils peuvent demander des dossiers bancaires, convoquer des bénéficiaires à l’hôtel de ville et, dans certains cas, effectuer des visites inopinées au domicile d’une personne. Au fur et à mesure que les enquêtes sont menées – ou des erreurs de paperasse fixes – des paiements ayant besoin de besoin peuvent être retardés. Et souvent – dans plus de la moitié des enquêtes sur les demandes, selon les chiffres fournis par Bodaar – la ville ne trouve aucune preuve d’actes répréhensibles. Dans ces cas, cela peut signifier que la ville a «harcelé à tort les gens», dit Bodaar.

Le système de contrôle intelligent a été conçu pour éviter ces scénarios en remplaçant finalement le travailleur social initial qui signale quels cas à envoyer au service des enquêtes. L’algorithme fermerait les applications pour identifier les plus susceptibles d’impliquer des erreurs majeures, en fonction de certaines caractéristiques personnelles, et rediriger ces cas pour un examen plus approfondi par l’équipe d’application.

Si tout se passait bien, la ville écrivait dans sa documentation interne, le système améliorerait les performances de ses travailleurs sociaux humains, signalant moins les candidats à l’enquête sur le bien-être tout en identifiant un plus grand proportion de cas avec des erreurs. Dans un document, la ville a prévu que le modèle empêcherait jusqu’à 125 AmsterDammers individuels de faire face à la collecte de dettes et d’économiser 2,4 millions d’euros par an.

Smart Check a été une perspective passionnante pour les responsables de la ville comme De Koning, qui gérerait le projet lors de son déploiement. Il était optimiste, car la ville adoptait une approche scientifique, dit-il; Cela «verrait si cela allait fonctionner» au lieu de prendre l’attitude que «cela doit fonctionner, et quoi qu’il arrive, nous continuerons.»

C’est le genre d’idée audacieuse qui a attiré des techniciens optimistes comme Loek Berkers, un scientifique des données qui a travaillé sur Smart Check dans son deuxième emploi à l’université. S’exprimant dans un café caché derrière l’hôtel de ville d’Amsterdam, Berkers se souvient avoir été impressionné lors de son premier contact avec le système: «Surtout pour un projet au sein de la municipalité», dit-il, c’était «une sorte de projet innovant qui essayait quelque chose de nouveau».

Smart Check a utilisé un algorithme appelé «machine de boosting explicable», ce qui permet aux gens de comprendre plus facilement comment les modèles d’IA produisent leurs prédictions. La plupart des autres modèles d’apprentissage automatique sont souvent considérés comme des «boîtes noires» exécutant des processus mathématiques abstraits qui sont difficiles à comprendre pour les employés chargés de les utiliser et les personnes touchées par les résultats.

Le modèle de contrôle intelligent envisageait 15 caractéristiques, notamment si les candidats avaient précédemment demandé des avantages ou des avantages, la somme de leurs actifs et le nombre d’adresses qu’ils avaient dans le dossier – pour attribuer un score de risque à chaque personne. Il a délibérément évité les facteurs démographiques, tels que le sexe, la nationalité ou l’âge, qui conduiraient à des biais. Il a également essayé d’éviter les facteurs de «proxy» – comme les codes postaux – qui peuvent ne pas sembler sensibles à la surface mais peuvent le devenir si, par exemple, un code postal est statistiquement associé à un groupe ethnique particulier.

Dans une étape inhabituelle, la ville a divulgué ces informations et partagé plusieurs versions du modèle de contrôle intelligent avec nous, invitant efficacement l’examen extérieur dans la conception et la fonction du système. Avec ces données, nous avons pu construire un destinataire de protection sociale hypothétique pour avoir un aperçu de la façon dont un candidat individuel serait évalué par Smart Check.

Ce modèle a été formé sur un ensemble de données englobant 3 400 enquêtes précédentes sur les bénéficiaires de l’aide sociale. L’idée était qu’elle utiliserait les résultats de ces enquêtes, menées par les employés de la ville, pour déterminer quels facteurs dans les candidatures initiaux étaient corrélés à une fraude potentielle.